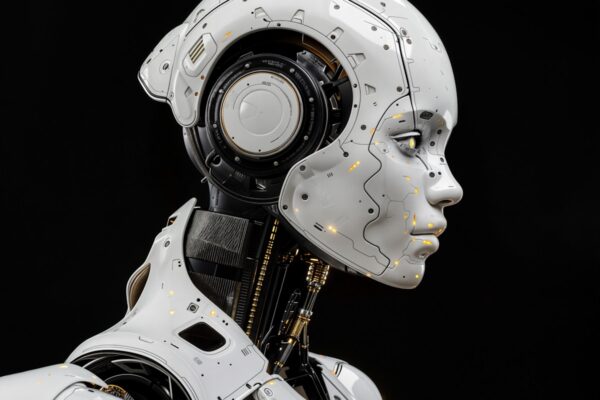

L’AI che decide chi vive e chi muore in guerra: il dilemma che nessun governo vuole affrontare

Nel marzo 2026, un drone autonomo ha colpito un obiettivo militare in una zona di conflitto. Nessun umano ha premuto il grilletto. L’AI ha identificato il target, calcolato il rischio di danni collaterali, e ha eseguito. Tempo dalla rilevazione all’azione: 0,8 secondi. Troppo veloce per chiedere permesso a un umano. E questa è esattamente la logica che terrorizza mezzo mondo.

Le armi autonome non sono fantascienza: sono qui

I Lethal Autonomous Weapons Systems (LAWS) — sistemi d’arma che selezionano e ingaggiano obiettivi senza intervento umano — sono già operativi in almeno 12 paesi. Non ne parliamo perché nessun governo ammette di usarli. Ma i dati parlano: nel 2025, il mercato globale delle armi AI ha superato i 15 miliardi di dollari.

Droni kamikaze con riconoscimento facciale. Torrette automatiche che distinguono combattenti da civili (o almeno ci provano). Sciami di micro-droni che operano come un organismo unico, senza comando centrale. La guerra del futuro è già la guerra del presente.

“La domanda non è se le macchine uccideranno autonomamente. Lo fanno già. La domanda è se stabiliremo regole prima o dopo la prima strage di civili causata da un bug nel codice.” — Jody Williams, Premio Nobel per la Pace

L’argomento a favore (che nessuno vuole fare)

Ecco la verità scomoda: l’AI potrebbe uccidere meno civili degli umani. Nelle guerre recenti, l’errore umano è responsabile del 60-70% delle vittime civili. Soldati stanchi, spaventati, vendicativi, confusi dalla nebbia di guerra — prendono decisioni terribili.

Un’AI non si vendica. Non ha paura. Non è stanca dopo 36 ore di combattimento. Può analizzare 50 variabili in un millisecondo e scegliere l’opzione con il minor danno collaterale. In teoria, le armi autonome potrebbero rendere la guerra meno letale per i civili.

In teoria.

L’argomento contro (che tutti dovrebbero fare)

Il problema è che “in teoria” non basta quando si parla di vite umane. Gli algoritmi di riconoscimento hanno tassi di errore. Su milioni di decisioni, anche un errore dello 0,1% significa migliaia di morti innocenti. E a differenza di un soldato, un’AI non ha rimorso, non testimonia in tribunale, non porta il peso morale delle sue azioni.

Ma il problema più profondo è un altro: chi è responsabile quando un’AI uccide un civile? Il programmatore che ha scritto l’algoritmo? Il generale che lo ha autorizzato? L’azienda che lo ha venduto? Il politico che ha firmato il contratto? Nella catena di responsabilità delle armi autonome, tutti puntano il dito verso qualcun altro. E nessuno paga.

La corsa agli armamenti AI è già iniziata

Mentre l’ONU discute (dal 2014, senza risultati), la corsa accelera. USA, Cina, Russia, Israele, Turchia, Iran — tutti investono massicciamente in armi autonome. E come per le armi nucleari, nessuno vuole essere il primo a disarmare.

La differenza cruciale? Le armi nucleari richiedono uranio arricchito, centrifughe, infrastrutture enormi. Le armi AI richiedono un laptop e un buon modello di machine learning. La barriera d’ingresso è così bassa che anche gruppi non statali possono svilupparle. E questo cambia tutto.

Tre scenari per il futuro

Scenario ottimista: un trattato internazionale tipo “Convenzione di Ginevra per l’AI” stabilisce regole chiare. Human-in-the-loop obbligatorio. Responsabilità legale definita. Moratoria sui sistemi completamente autonomi.

Scenario realistico: accordi parziali tra alcuni paesi, ignorati da altri. Proliferazione graduale. Incidenti occasionali che generano indignazione temporanea ma nessun cambiamento strutturale.

Scenario pessimista: nessun accordo. Corsa agli armamenti incontrollata. Un incidente catastrofico — un’AI che distrugge un ospedale, uno sciame di droni fuori controllo — prima che qualcuno agisca.

Il tempo per scegliere quale scenario vogliamo si sta esaurendo. E il silenzio dei governi è, di per sé, una scelta. La peggiore possibile.